SEO Técnico

¿Qué es SEO Técnico?

El SEO técnico es una parte del posicionamiento en motores de búsqueda y que se concentra en las optimizaciones técnicas de una web, por ejemplo, Web Performance,Optimizaciones de código,Cambios en el servidor,Implementación de datos estructurados,etc.

A continuación se documentan 10 optimizaciones para comprobar que el SEO Técnico de tú web o blog cumple un mínimo de requisitos para que no haya ningún tipo de problema en que Googlebot pueda acceder a tu sitio web.

Igualmente, se provee información para la crawlabilidad e indexabilidad de un sitio web.

Como se puede ver en estas slides, donde se hace un análisis de SEO Técnico en profundidad con Screaming Frog Sin indexación no hay posicionamiento en buscadores.

Pero para que una web pueda ser indexada, primero tiene que poder ser crawleada. Esto supone un trabjo de análisis de SEO Técnico.Por ello, también se van a ofrecer consejos para comprobar que los bots pueden acceder sin problemas y sean capaces de encontrar la información por la que se quiere posicionar.

La versión cacheada de Google encuentra el contenido

- Versión completa - Es la versión que se puede ver en el navegador

- Versión solo texto - Al hacer click podremos ver la información que el buscador ha encontrado

- Ver origen - En esta opción se verá el código fuente

Configuración del fichero robots.txt

Asegurate de que no hay recursos bloqueados a los bots

El fichero robots.txt no presenta errores

Comprueba que lo que ve el usuario en el navegador es lo que ve Googlebot

Asegurate que los ficheros CSS, JS e imágenes no están bloqueados por robots

Enlaces rotos o errores de crawlabilidad

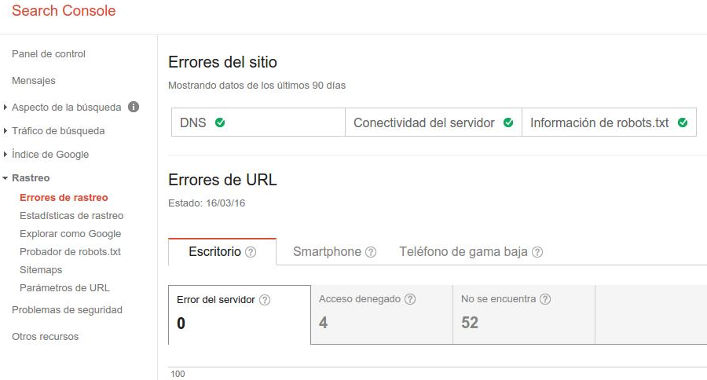

Errores de Servidor - Error 500 o 503

Acceso denegado ( Comprobar el fichero robots.txt ) - Código de respuesta 403

Errores 404 ( urls no se encuentran )

Comprobar que el renderizado del HTML es correcto

Validar los datos estructurados o schema

Configurar URL's con parámetros en Search Console

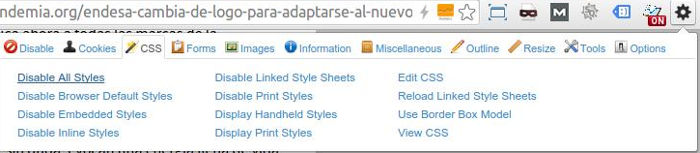

Deshabilita CSS y comprueba la información en la pagina es la misma para Googlebot y para el usuario

Actualización del Sitemap XML vs Sitemap HTML vs RSS

Ya hemos comprobado que los bots pueden acceder a la web sin problemas y que los enlaces dentro de la web permiten generar un camino por el cual los crawlers pueden acceder a la información de todas las páginas.

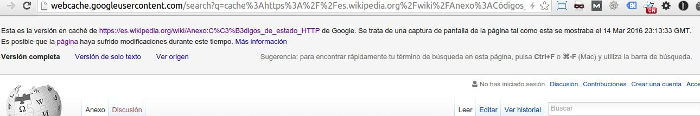

Ahora tenemos que comprobar que la información que se muestra en esas páginas, puede ser procesada por los buscadores. Para ello, vamos a visualizar si la versión cacheada en el navegador de Google contiene toda la información que se provee en la página web.

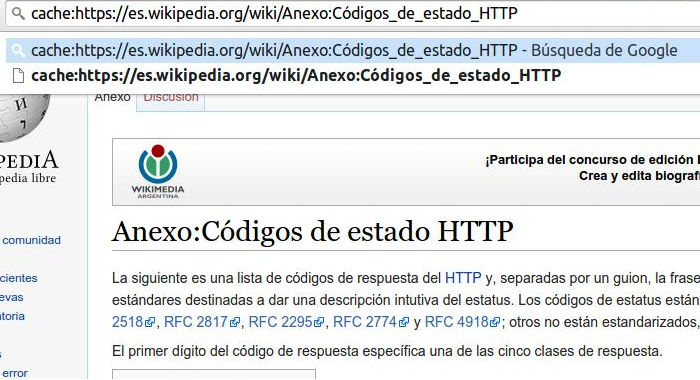

Para poder llevar a cabo esta tarea, edita la URL en la barra de dirección del navegador de manera que introduzcas al inicio de la misma la palabra cache: y pulsa Intro, como aparece en la imagen siguiente:

El resultado será algo similar a lo que aprecia en la imagen, aparecerán 3 opciones en la parte superior izquierda en las podrás ver como se renderiza la web para la versión completa ( lo que ve el usuario ); la versión texto, es el contenido que puede ver el bot o crawler y finalmente la opción "Ver origen" que es código.

Se puede comprobar que aparecen las diferentes opciones:

Asegurate de que no hay restricciones para los bots al acceder. Eso si, se puede configurar este fichero para determinar qué bots pueden acceder y cuales no. Del mismo modo, se puede determinar qué secciones de la web quieres que sean crawleadas o no.

Aquí se facilita la documentación oficial de Google para la creación de un fichero robots.txt y la configuración del mismo. Como crear un fichero robots.txt

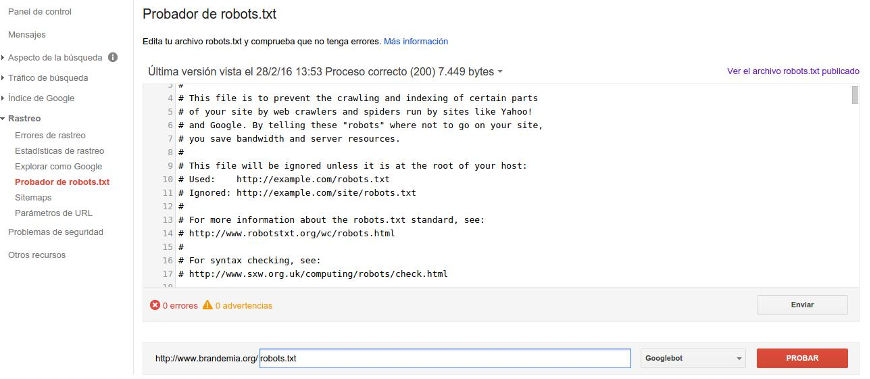

Mediante la herramienta Search Console, se pueden comprobar qué elementos están bloqueados y los diferentes errores que pueden aparecer en relación a la configuración del fichero robots.txt

Para poder estar seguros de que no aparecen errores en los puntos que hemos comentado, mediante Search Console se pueden comprobar:

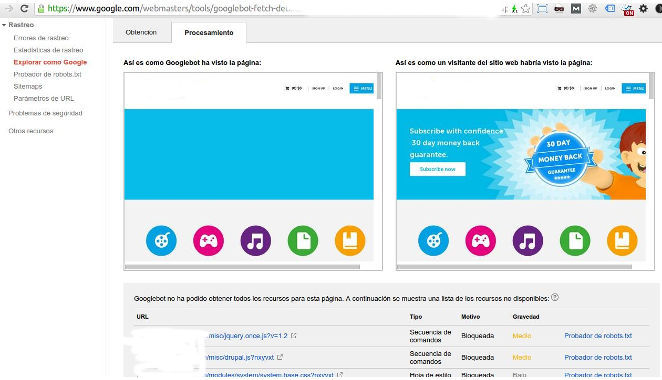

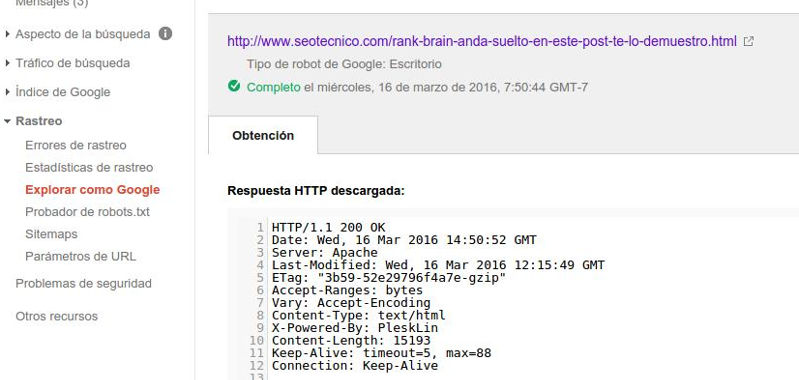

En caso de que al analizar la versión cacheada la información que ven los bots no sea la misma que se muestra en el navegador, es decir la que el usuario pueder ver, puede que sea debido a una error de crawleo, como se puede comprobar en la imagen siguiente:

Al ejecutar Rastrear como Google, vemos que en la parte izquierda el mensaje "Así es como Googlebot ha visto la página" difiere de la parte derecha "Así es como un visitante del sitio web habría visto la página". Esto se debe a que hay elementos bloqueados que éstán impidiendo el acceso total a ficheros CSS y JS y cuyos mensajes nos indican los errores de configuración en el fichero robots.txt.

En este artículo de Moz Por qué todos los SEOs deberían desbloquear CSS y JS se documenta la necesidad de configurar el fichero robots.txt para permitir el acceso a fichero CSS y JS.

Para estar completamente seguro de que están desbloqueandos todos los ficheros JavaScript y CSS, se puede añadir al fichero robots.txt, las siguientes líneas de código:

User-Agent: Googlebot

Allow: *.js

Allow: *.css

Si en el archivo robots.txt se están bloqueando directorios completos, puede ser un poco más complicado.En estos casos, también es necesario permitir el acceso a los bots de Google para cada uno de los directorios que ha bloqueado.

Por ejemplo:User-Agent: Googlebot

Disallow: /modulos/

Allow: /modulos/*.js

Allow: /modulos/*.css

Igualmente Matt Cutts lo explica en este vídeo:

Lo primero es el crawleo, por ello se tiene que comprobar que no hay restricciones para que los bots puedan acceder a la información.

Esto supone que una vez se les ha facilitado la vía de entrada, hay que asegurarse que los enlaces internos que existen en el contenido o en las diferentes secciones de la web, no tienen errores, es decir, las arañas de Google y el resto de buscadores pueden seguir rastreando el resto de páginas.

Una herramienta con la que puedes comprobar que no hay enlaces rotos dentro de tú web es Brokenlinkcheck

Para poder evaluar los diferentes problemas de crawlabilidad que puedan estar ocurriendo, mediante la herramienta Search Console podemos acceder a la sección Rastreo >> Errores de rastreo

Algunos de los errores más comunes son:

Aquí puedes disponer del listado de respuestas HTTP de servidor y qué significa cada uno de ellas: Códigos de estado HTTP

Lo realmente importante en este caso es que en la versión cacheada de Google, concretamente en "Versión solo texto", el buscador haya podido encontrar todo el contenido o la información por la que nos interesa posicionar.

En caso contrario, sería recomendable comprobar por qué la información no se renderiza corréctamente. Puede ser por que la implementación esté hecha con AJAX, la web esté hecha con un Framework en Javascript que preprocesa el renderizado del HTML o cualquier otra incidencia técnica.

Dicho esto, pasamos a evaluar la siguiente mejora técnica que se tendría que tener en cuenta.

¿Cómo hacemos esto?, mediante Search Console se puede ejecutar "Explorar como Google". Seleccionar una página de tú web, y una vez se ha llevado a cabo la tarea comprueba que la respuesta HTTP de descarga es correcta.

En el caso de que aparezca cualquier error, por ejemplo, la respuesta HTTP no sea 200 OK, muestre un mensaje de que la URL está bloqueada, la URL no se encuentra, etc, entonces de nuevo sería necesario comunicar con el equipo técnico para solucionar este problema, ya sea por configuración de robots.txt, error de servidor, etc.

En este caso se facilita el enlace a la herramienta para poder validar la implementación de los Rich Snippets, ya sea en el markup ( mediante código HTML en el template) o mediante JSON, es una buena práctica comprobar que la implementación de los datos estructurados para conseguir resultados con respuestas es correcta.

Validador de schema o microformatos

Schema.org es un vocabulario específico de etiquetas (o microdatos) que se pueden agregar a su HTML para la forma en que su página es entendida por los motores de búsqueda.

Schema.org es el resultado de la colaboración entre Google, Bing, Yandex, y Yahoo! para ayudar a proporcionar la información de sus motores de búsqueda mediante un lenguaje estándar que permita entender el contenido por parte de las máquinas y ofrecer los mejores resultados posibles de búsqueda.

Implementar Rich Snippets en HTML mejora la forma en que su página pueda ser mostrada en las SERPs mediante la mejora de los fragmentos enriquecidos que se muestran debajo del título de la página.

schema.org es el sitio oficial donde podrá encontrar las últimas actualizaciones, una guía para la implementación de esquemas y preguntas frecuentes.

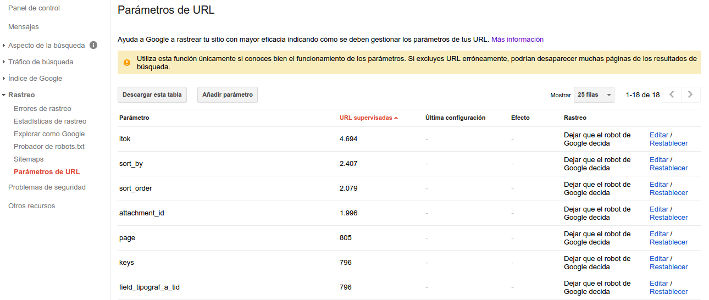

Normalmente, las URLs con parámetros se generan en páginas webs que ofrecen diversas opciones de clasificación como Ordenar = relevancia, tipo = ascendente, paginación y así sucesivamente, que también se debe tener en cuenta como parámetros de URL.

Por lo general, todo depende de la configuración del sitio, la arquitectura y la tecnología que se utilice para mostrar u ordenar la información.

Una buena práctica SEO es la generación de URL-friendly, cuya URL no contiene parámetros dinámicos y contiene las keywords por las que se quiere posicionar.

A continuación vamos a ver como gestionar la crawlabilidad de las URL's con parámetros a través de Search Console.

La administración de parámetros es una opción útil para ayudar a la indexación, merece la pena desde el punto de vista de aumento de tráfico orgánico y desindexación de páginas que se se indexan en los motores de búsqueda pero no aportan valor a la captación de nuevos usuarios en los buscadores, un ejemplo de URL con parámetros es: www.domino.com/?utm_campaign=coschedule&utm_source=twitter&utm_medium=.

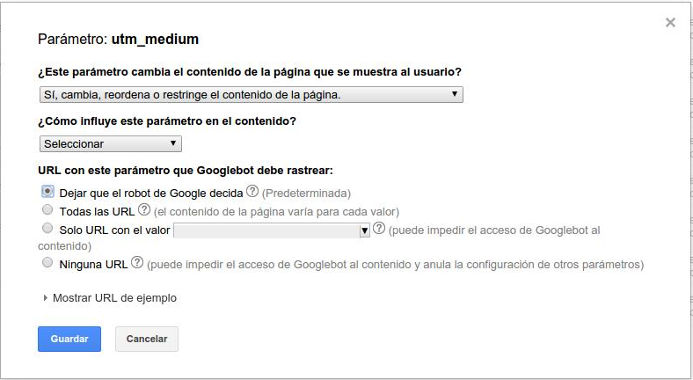

Al hacer clic en Editar,en la opción del parámetro que se quiera configurar, aparecerá una interfaz donde se podrá determinar qué se quiere hacer con las URLs que contengan dicho parámetro.

El objetivo es minimizar el número de URL's con parámetros indexadas, de manera que sea más fácilmente rastreable por Google, lo que aumentará la frecuencia de rastreo de su sitio, y también tendrán un costo menor en el ancho de banda necesario para crawlear la información.

Mi recomendación sería, comprobar qué URLs con parámetros tiene indexados Google de su sitio web y además que parámetros ha detectado en Search Console.

Una vez identificadas las URL's con parámetros indexadas que no traigan tráfico orgánico, desindexar las mismas. Paralelamente, condigurar las URL's con parámetros para la crawlabilidad de indexabilidad.

Documentación oficial de Google para categorizar parámetros en Search Console

En este caso no nos referimos a que haya información que se carga en el navegador, pero que los usuarios no ven.

Nos referimos a que la información que se carga en el DOM, tiene que ser la misma que los crawlers procesan, es decir, que no se esté cargando ninguna información extra en la plantilla de manera que se repita en secciones de la web donde no es útil.

Para poder hacer esta comprobación es necesario tener instalado, ya sea en Firefox o Chrome la extensión "Web Developer Toolbar". Una vez se instale, ir a la sección: CSS >> Disable all styles

El objetivo es encontrar aquellas imágenes, textos o contenidos que se cargan al hacer la petición HTTP de la página, es decir al cargar la misma, pero cuya información no se ve en el navegador por el usuario.

Estos fallos suelen ser comunes en CMS o plataformas que utilizan un sistema de plantillas, de manera que se cargan en todas las páginas, pero que no aportan valor al contenido, consumen recursos y no los bots lo pueden interpretar como Cloaking.

Igualmente pueden estar presentes en webs que estén desarrolladas con implementaciones AJAX, de manera que la información se cargue pero esté oculta y que se muestre cuando se ejecuta un evento en Javascript. Una vez el usuario interactua con la web y hace click, scroll o cualquiera otra interactuación, la información será mostrada u ocultada.

En estos casos, es necesario volver al paso 1 y comprobar la información cacheada por Google.

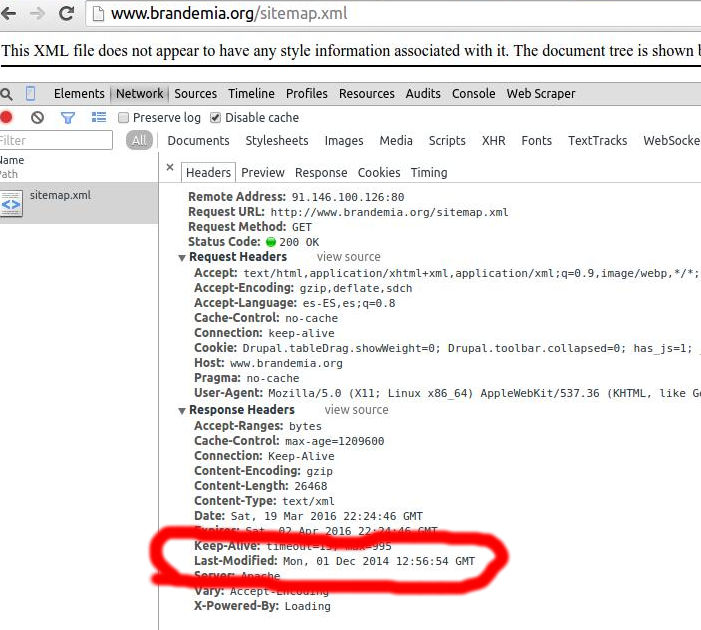

Seguro que esta cuestión levanta un poco de controversia, como puedes comprobar en la imagen, el Sitemap XML en la web de Brandemia lleva sin actualizarse más de un año y sigue aumentando el tráfico orgánico, como puedes ver aquí: Aumento de tráfico orgánico con SEO Técnico

La vía alternativa para la crawlabilidad e indexación de la web ha sido esta: Vista RSS en Drupal para la crawlabilidad

Es una buena práctica la actualización del fichero Sitemap XML y hacer ping en Search Console en caso de que no exista otra alternativa, como puede ser un Sitemap HTML.

Cada SEO aplica los cambios que considera que serán mejores en base a las características del CMS, el control que tenga sobre la parte técnica o las restricciones que haya por parte del cliente a la hora de implementar las diferentes opciones para el posiciconamiento en buscadores.

La implementación de un Sitemap que permita mejorar desde el SEO Técnico la crawlabilidad e indexabilidad de cualquier sitio web es un factor fundamental a la hora de llevar a cabo una estrategia o una campaña de search.

Independientemente de cual sea la opción elegida se recomienda como una buena práctica para mejorar el posicionamiento web en buscadores la implementación de cualquiera de las alternativas presentadas para poder conseguir mejores resultados en las búsquedas y así conseguir que nuestros proyectos obtengan una mejor visibilidad en los diferentes buscadores.